第三章 人机大战:AI真的会挑战人类?(第9/15页)

·非破坏性:通过控制高度先进的人工智能系统获得的权力,应当尊重和提升一个健康的社会赖以维继的社会和公民进程,而不是破坏这些进程。73

应当说,在担忧未来人工智能威胁的人中,霍金和马斯克还是一直抱有一种非常积极的态度的。他们一方面基于自己的逻辑判断,相信人类未来面临机器威胁的可能性非常大;另一方面又利用自己的影响力,积极采取行动,尽可能将人工智能置于安全、友好的界限内。从这个角度讲,霍金和马斯克至少比那些盲目的悲观主义者,或因未来的不确定性而丧失勇气的怯懦者强很多很多倍。

理智分析:人类离威胁还相当遥远

那么,我们到底该怎样看待“人工智能威胁论”呢?

《人工智能时代》的作者,计算机科学家、连续创业家、未来学家杰瑞·卡普兰(Jerry Kaplan)与我讨论这个问题的时候,他的观点是:

超人工智能诞生并威胁人类这件事发生的概率是非常小的。其实,我们现在做的只是在制造工具,以自动完成此前需要人类参与才能完成的工作任务。之所以会有“人工智能威胁论”的疑问,根本上是因为大众习惯于把人工智能人格化,这是问题的根源。74

这件事对于专业人士和对于大众的意义是不一样的。例如,大众总是担心无人驾驶汽车可能伤及人类的生命。在一些极端的例子里,无人驾驶汽车确实需要做出决定,是要撞向左边,伤及左边的行人呢,还是要撞向右边,伤及右边的行人。但无人驾驶汽车只是一套机器系统,它们并不会真正做出决策。它们只是根据对环境的感知,按照某种特定的原则和设计做出反应,而我们人类对于整套系统的感知和反馈模式拥有完全的控制权。如果它们做了什么不符合我们社会准则的事情,那一定是因为我们人类在设计它们时犯了错误。

我们所面对的,只不过是一系列工程设计上的问题。我们必须确保我们设计制造的产品和服务符合我们的愿望和预期。你知道,这件事与桥梁工程师们使用一整套质量保障方案来确保他们建造的桥梁不会坍塌并没有什么两样。我们有许多工程学上的原则,来指导我们测试一个系统,什么样的系统是合格的,什么样的系统是足够安全的,等等。在人工智能领域,我们同样需要这样的技术,因为人工智能十分强大,具有潜在的危险性。但这并不是因为智能机器会像人类一样思考,只是因为它们十分强大,我们必须小心使用它们。

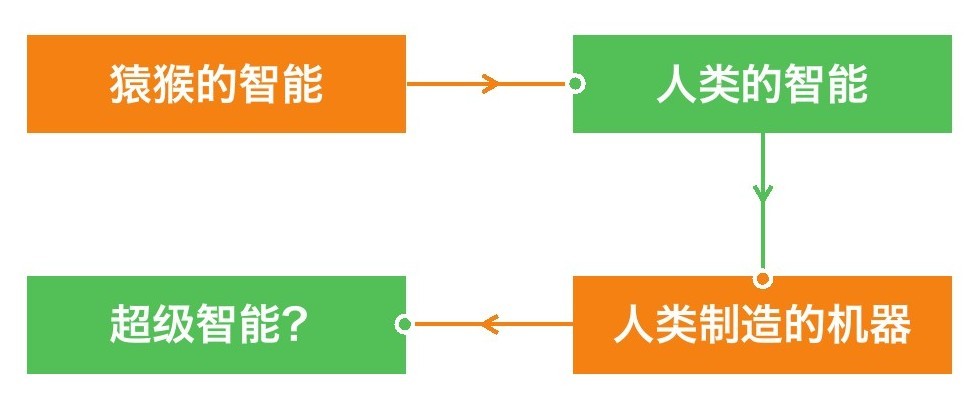

“智能”经历了相当长时期的演进,从猿猴的智能,到人类的智能,再到人类制造的人工智能技术和智能机器。那些预测超级智能的人是按照这样一种演进趋势来思考问题的:

图32 关于智能演进的线性思考

但这种线性结构是有问题的,因为我们并没有一种简单的方式来对智能进行度量。这和测量体重或鞋子尺码很不一样。智能是一个非常定性的概念,它反映的是某个人成功解决某种特定问题的能力。例如,人们总是会问,如果人工智能的智商达到200,那会发生什么呀?可是,什么是人工智能的智商?实际上,智商在这里是一个被极度滥用了的概念。心理学家使用一种叫发展能力(Developmental Competence)的概念来评估人类。他们测试一个人解决算术、逻辑等问题的水平,然后将测试所得的分数除以这个人的年龄——这是智商的含义。如果某人解决此类特定问题的能力超出同龄人的平均水平,我们就说他的智商高。但是,该如何定义一部机器的智商呢?如何定义一部机器的年龄?机器可以用比人类快一百万倍的速度解决算术问题,那么,这些机器的智商是多少?这种说法其实并没有什么实际意义。

所以,问题首先在于,对智能的定义是非常主观的,这依赖于每个人自己的视角。这一点非常像我们对美的定义。你可以说某些人比其他人长得美,或者说一个人比另一些人更聪明,但希望把美或把智商的定义客观化、量化的想法是错误的。其次,关于智能的度量并不是线性的,而是一种多维度的度量。如果你用算术能力来评估,那机器已经非常聪明了。但你如何将机器纳入一个多维度的度量体系?让一部机器变得更聪明,这句话到底意味着什么?

也就是说,在今天这个弱人工智能的时代里,人类对于人工智能,或者什么是“智能”的认识本身就是缺乏深度的,我们也没有一个合适的、可操作的标准,来真正定义什么是强人工智能,什么是超人工智能。